北京pk10 DeepSeek-OCR 2大模子开源, 重塑文档AI的剖释逻辑

【TechWeb】1月27日音信,深度求索(DeepSeek)团队发布了论文《DeepSeek-OCR 2: Visual Causal Flow》并开源了同名模子DeepSeek-OCR 2。这一模子是对昨年10月20日发布的DeepSeek-OCR模子的升级。 3个月期间,从DeepSeek-OCR到DeepSeek-OCR 2,论文提到在巨擘的概述性文档意会基准OmniDocBench v1.5上,DeepSeek-OCR 2获取了91.09% 的分数,较其前代大幅普及3.73%。 其中...

【TechWeb】1月27日音信,深度求索(DeepSeek)团队发布了论文《DeepSeek-OCR 2: Visual Causal Flow》并开源了同名模子DeepSeek-OCR 2。这一模子是对昨年10月20日发布的DeepSeek-OCR模子的升级。

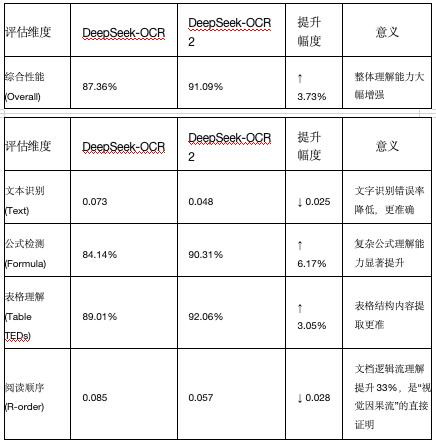

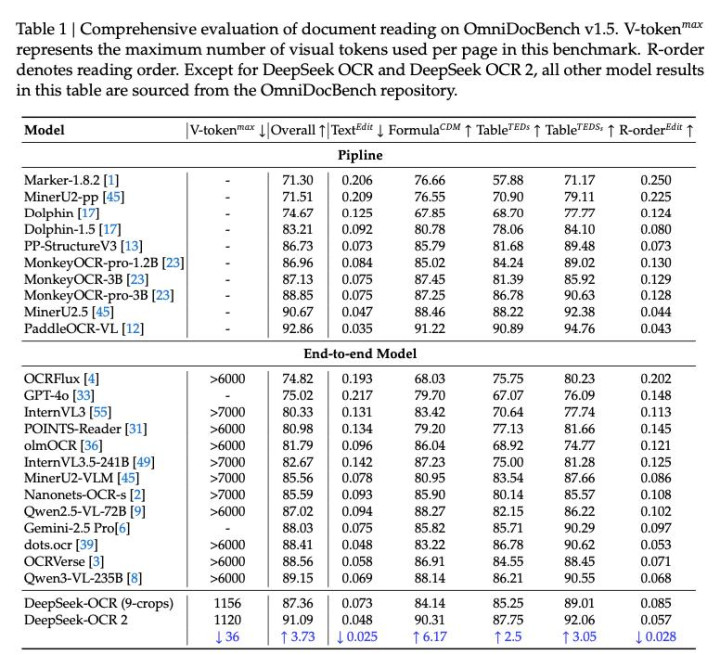

3个月期间,从DeepSeek-OCR到DeepSeek-OCR 2,论文提到在巨擘的概述性文档意会基准OmniDocBench v1.5上,DeepSeek-OCR 2获取了91.09% 的分数,较其前代大幅普及3.73%。

其中枢鼎新在于提议了“Visual Causal Flow” (“视觉因果流”) 这一全新的编码范式。

注:R-order值为模子输出功令与圭臬功令之间的圭臬化剪辑距离,数值越低,阐述模子的输出越准确、逻辑功令越正确。

中枢鼎新:DeepEncoder V2 架构引入Visual Causal

传统的OCR(光学字符识别)技巧,时常遴荐一种近似“机械扫描”的计策:将图像切割成网格,然后按照从左到右、从上到下的固定功令识别笔墨。这种神态在处分通俗文档时灵验,但一朝靠近充满表格、多栏排版、数学公式或复杂图示的学术论文、薪金时,其输出的文本时常逻辑芜杂,丢失了内容之间内在的语义探究。

DeepSeek-OCR 2的计议不再知足于让模子“看见”笔墨,而是拦截于于让它像东说念主类雷同,先“意会”文档的视觉结构与内容逻辑,再“敷陈”出文本。

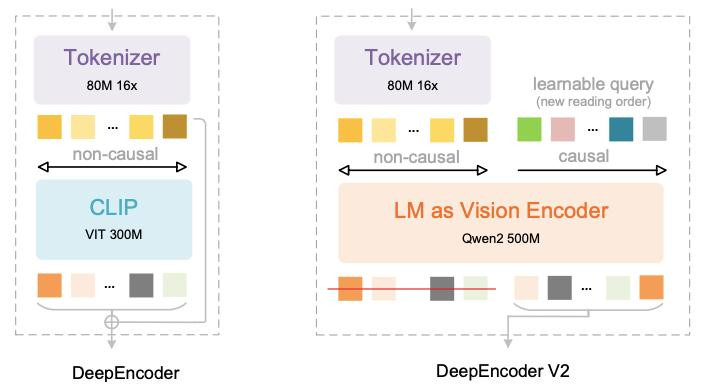

DeepSeek-OCR 2引入的 DeepEncoder V2 架构。

从DeepSeek-OCR的DeepEncoder架构,到DeepSeek-OCR 2的 DeepEncoder V2 架构,有了哪些升级?

DeepEncoder V2被盘算推算用于赋予编码器因果推理才能,使其好像在大说话模子进行内容解读之前,智能地对视觉秀美进行重排。

{jz:field.toptypename/}DeepEncoder V2像一位领有全局不雅的阅读者。它的使命经过分为三步,扫尾了剖释上的飞跃:

率先,全局不雅察:模子通过双向戒备力机制,无遗漏地“瞟见”整页文档的整个视觉信息。

接着,逻辑推理:模子的中枢组件——“因果流查询”启动使命。它不再受制于空间功令,而是字据内容的语义进攻性、排版结构和逻辑探究,动态地推理出一个最合理的“阅读功令”。举例,它会先读完一个文本栏,再跳转到控制的图表标题,然后处分下方的表格,临了识别侧边栏的注视。

临了,有序压缩:模子按照这个自我推理出的逻辑功令,北京pk10官网将高维的视觉信息压缩、重排为一串低维的、富含语义的“视觉秀美”。

这一过程的中枢是将空间优先的编码养息为语义优先的编码。论文指出,这种“因果流”机制使模子输出的视觉序列自己就佩戴了强横的功令因果性,为后续的说话解码器提供了结构明晰、逻辑绽开的“念念考蓝图”。

从服从到意会的全面冲破

基于“视觉因果流”这一底层鼎新,DeepSeek-OCR 2展现出了一系列显贵优于前代及同类模子的才能。

率先,是惊东说念主的处分服从。它仅需256至1120个视觉秀美就能精确暗示一页复漫笔档的内容,达到了极高的视觉信息压缩率。这极地面放松了下流大说话模子的计较包袱,使得将高质料文档图像意会才能集成到各样AI运用中变得更为可行。

其次,在复漫笔档意会上扫尾了质的冲破。模子在学术论文、金融报表、杂志等包含多栏、浮动体、数学公式的文档上发达尤为出色。它不仅准确识别笔墨,更能归附内容间的逻辑功令,输出后的文本无需大齐后期养息即可平直用于分析或存档。

最终,这些上风养息为了硬性的性能普及。在巨擘的概述性文档意会基准OmniDocBench v1.5上,DeepSeek-OCR 2获取了91.09% 的分数,较其前代大幅普及3.73%。更具劝服力的是,在推断阅读功令准确度的关节谈论(圭臬化剪辑距离)上,其性能普及了约33%。在本色出产环境的测试中,模子输出的交流和意外旨内容也显贵减少,诠释了其不凡的褂讪性和可靠性。

异常OCR的通用模态编码器雏形

DeepSeek-OCR 2的价值远不啻于一个更广宽的OCR用具。它算作高质料文本数据的出产引擎,不错为大说话模子的考核提供海量、精确的文本语料。更进攻的是,它所考据的“让模子自主决定信息处分功令”的“因果流”念念想,为下一代多模态东说念主工智能架构指明了标的。

论文预测,这一旨趣有望发展成为一个长入的全模态编码器。异日,无论是文本、图像、音频仍是视频,模子齐不错先通过雷同的“因果流”机制,意会该模态信息的内在结构与逻辑,再将其压缩为长入的、富含语义的中间暗示,从而扫尾更深脉络、更接近东说念主类剖释神态的跨模态意会与生成。

虽然,计议也坦诚指出了面前模子的局限,举例在文本终点密集,如古典报纸的场景下,识别后果仍有优化空间。

备案号:

备案号: